AI는 규모의 법칙을 따른다.

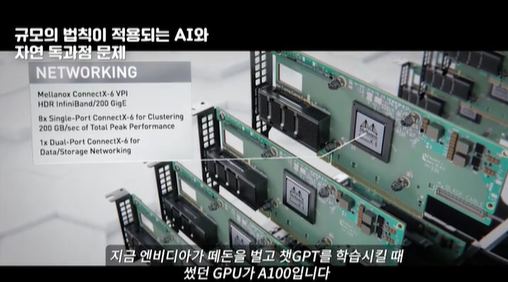

엔비디아는 GPU칩으로 떼돈을 벌고 있다.

엔비다의 GPU A100은 챗 GPT를 학습할 때 쓰였다.

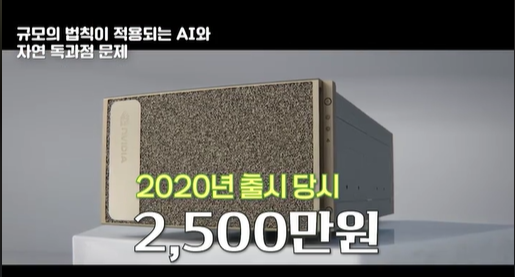

GPU A100은 2020년 출시 당시 개당 2500만원에 달하는 가격이었다.

A100의 성능도 우수하지만, 이것 보다 더 좋은 GPU가 엔비디아의 후속작 H100이다.

H100을 세트로 구매할 때는 1억 몇천만원이고 한 대의 가격도 몇천만원이다.

페이스북의 메타는 H100을 35만장 구매 계획이고, 일론 머스크의 테슬라도 10만 장 단위로 구매하는 것은 기정사실이다.

마이크로소프트의 클라우드 시스템에도 H100과 A100이 메타와 테슬라 수준 만큼 사용되고 있을 것이다. 아마 휠씬 더 많은 GPU가 사용되고 있을 수 있다.

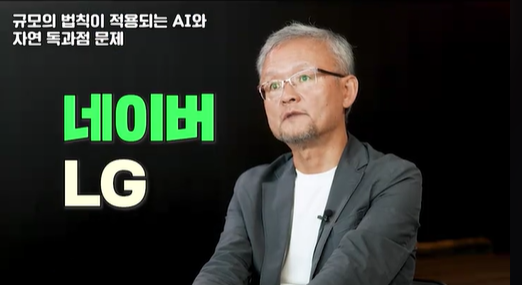

글로벌 대기업들이 앞다퉈 AI에 투자하는 미국과 달리, 한국에는 사실상 AI를 하고 있다고 할 수 있는 곳은 두 군데 뿐이다.

그 두 곳은 네이버와 LG이다. 나머지 회사들은 다 소규모 AI를 개발하고 있으며, 거대 규모는 손도 못 대고 있다.

미국 AI를 한국이 따라갈 수 없는 이유